Gemini 2.5 Proとは?機能や使い方、料金を徹底解説

この記事でわかること

- Gemini 2.5 Proの概要

- Gemini 2.5 Proの基本性能と機能

- Gemini 2.5 Proの性能評価や他モデルとの違い

- Gemini 2.5 Proの利用方法や実践的な活用方法

Google DeepMindが2025年3月に発表した最新AI「Gemini 2.5 Pro (experimental)」が注目を集めています。思考型モデル(Thinking Model)として設計され、回答前に推論プロセスを経ることで精度と正確性を大幅に向上させた次世代AIです。

100万トークン対応の長文脈処理能力、ネイティブマルチモーダル機能など、従来のAIを超える性能を持ち、多くのベンチマークでトップスコアを記録しています。企業のIT担当者からマーケティング部門、経営層まで、この最新技術をどう活用すればビジネスに革新をもたらせるのか。本記事では、Gemini 2.5 Proの基本機能から実践的な活用法、料金体系まで徹底解説します。

目次

Gemini 2.5 Proとは?

※引用:https://deepmind.google/technologies/gemini/pro/

Googleの研究部門であるGoogle DeepMindが2025年3月25日に発表した最新の生成AIモデルです。「思考型モデル」として、複雑な推論能力と長文脈理解を備えています。

Gemini 2.5 Proは思考型モデル(Thinking Model)

Gemini 2.5 Pro(experimental)の最大の特徴は、「思考型モデル(Thinking Model)」として設計されていることです。従来の生成AIモデルと異なり、回答を生成する前に推論プロセスを経ることで、精度と正確性を大幅に向上させています。

AIにおける「推論」とは、単なる分類や予測を超えて、情報を分析し、論理的な結論を導き出し、文脈やニュアンスを取り入れ、情報に基づいた意思決定を行う能力を指します。Google DeepMindは長期にわたり強化学習やチェーン・オブ・ソート(chain-of-thought)プロンプティングなどの技術を通じて、AIをよりスマートで推論能力の高いものにする方法を模索してきました。

この流れの中で最初の思考型モデルとして「Gemini 2.0 Flash Thinking」が登場し、Gemini 2.5ではさらに進化を遂げています。強化された基本モデルと改良されたポストトレーニングを組み合わせることで、新たなレベルのパフォーマンスを達成しました。今後はすべてのモデルに思考能力を直接組み込み、より複雑な問題処理とコンテキスト対応エージェントのサポートを実現していく方針です。

100万トークン対応と高度な推論機能

Gemini 2.5 Proの際立った特長として、現在100万トークン(近い将来には200万トークンに拡張予定)という圧倒的な長文脈処理能力を持つことが挙げられます。これにより、テキスト、音声、画像、動画、さらにはコードリポジトリ全体など、様々な情報源からの膨大なデータを一度に理解・処理することが可能になりました。

この長文脈対応と高度な推論機能を組み合わせることで、Gemini 2.5 Proは複雑な問題解決能力を発揮します。

Gemini 2.5 Proは、数学や科学のベンチマークでも優れた成績を収めています。これは、複雑な思考プロセスを必要とする問題に対する同モデルの高い能力を実証する結果といえるでしょう。

Gemini 2.5 Proの強み|3つの主要能力

Gemini 2.5 Proが他の生成AIと一線を画す理由は、高度な推論能力、ネイティブマルチモーダル対応、そして長文脈処理という3つの主要能力にあります。これらの機能が組み合わさることで、ビジネスにおける複雑な課題解決を可能にします。

高度な推論能力と複雑な思考プロセス

※引用:https://blog.google/technology/google-deepmind/gemini-model-thinking-updates-march-2025/#enhanced-reasoning

Gemini 2.5 Proの最も際立った特徴は、その優れた推論能力です。回答を生成する前に思考プロセスを経ることで、複雑な問題に対しても精度の高い解決策を提供します。

人間の嗜好性を測るLMArenaリーダーボードでは大幅なマージンで首位を獲得し、知識のフロンティアを評価する「Humanity’s Last Exam」ではツール使用なしのモデルで最高となる18.8%のスコアを達成しています。また、科学分野のGPQAでは84.0%、数学の難関テストAIME 2025では86.7%というトップクラスの成績を収めています。

こうした高度な推論能力により、従来のAIでは困難だった複雑な意思決定支援や専門的な問題解決が可能になり、企業の戦略立案や研究開発プロセスを大きく効率化することができます。

ネイティブマルチモーダル対応の威力

Gemini 2.5 Proは設計段階からマルチモーダル処理を前提としており、テキスト、音声、画像、動画、コードなど多様な形式のデータを統合的に理解・処理することができます。視覚的推論能力を測るMMUUベンチマークでは81.7%、画像理解を評価するVibe-Evalでは69.4%というスコアを達成し、マルチモーダル処理における優位性を示しています。

この能力により、例えば製品マニュアルの画像と説明文を同時に分析して問題点を特定したり、会議の音声と資料を組み合わせて包括的な要約を作成したりといった高度なタスクを実行できます。ビジネスにおいては、マーケティング資料の分析、顧客フィードバックの多角的理解、視覚的に魅力的なWebアプリケーションの開発など、多様な活用シーンが考えられます。

長文脈処理と大規模データ理解力

Gemini 2.5 Proの3つ目の強みは、100万トークン(近い将来には200万トークンに拡張予定)という圧倒的な長文脈処理能力です。この能力は、大量のデータを一度に処理し、複雑な関係性を理解するうえで極めて重要です。

長文脈理解力を評価するMRCRベンチマークでは、128kコンテキストで91.5%、1Mコンテキストでも83.1%という高いスコアを達成しており、大量のデータを処理する能力の高さが証明されています。

この長文脈処理能力により、企業は複数の長文ドキュメントを同時に分析して洞察を得たり、大規模コードベースを一度に理解して効率的な改善提案を受けたりすることが可能になります。また、過去の全社的なデータを包括的に分析し、時系列的なパターンや相関関係を発見するといった用途にも有効です。

Gemini 2.5 Proの3つの主要能力がもたらすビジネス価値まとめ

・高度な推論能力:複雑な問題解決の質と速度の向上

・ネイティブマルチモーダル対応:多様なデータからの統合的な洞察獲得

・長文脈処理:大量情報の包括的分析と長期的な文脈理解

これら3つの能力を組み合わせることで、Gemini 2.5 Proは従来のAIツールでは難しかった複雑な業務課題に対応し、企業の意思決定プロセスや業務効率化に大きく貢献します。

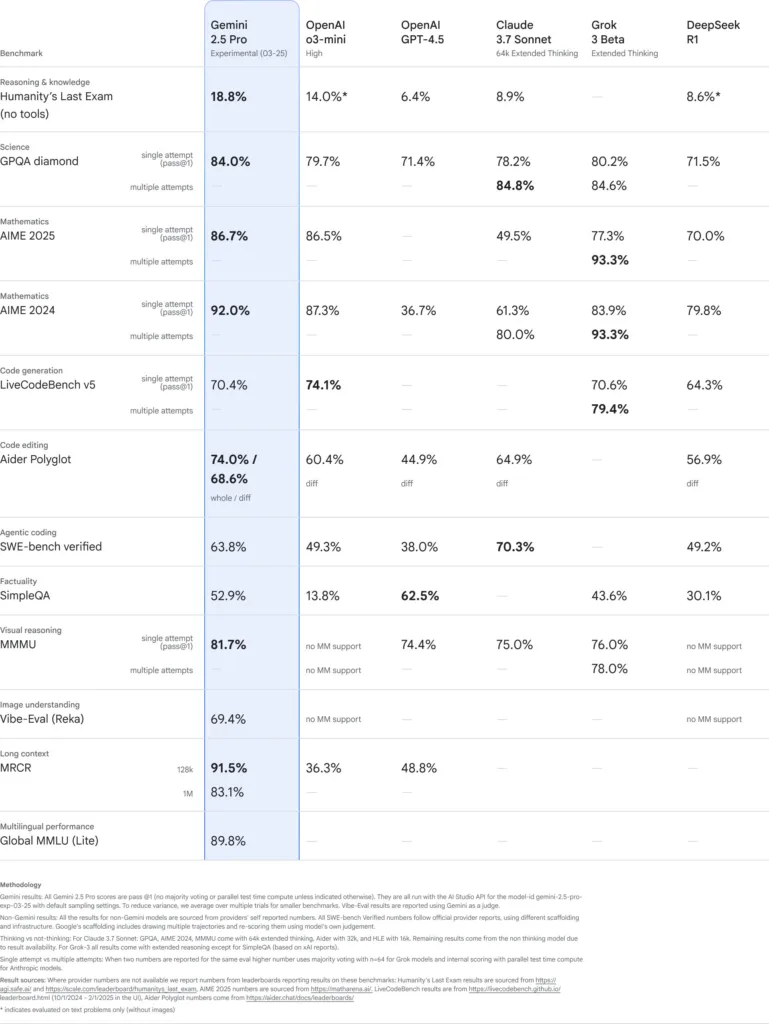

Gemini 2.5 Proの性能|他モデルとの比較

※引用:https://deepmind.google/technologies/gemini/pro/

生成AIの性能評価には多様な指標がありますが、Gemini 2.5 Proは幅広いベンチマークで他の最先端AIモデルを上回る結果を示しています。ここでは、Googleの他のGeminiモデルとの違いや、ChatGPTやClaudeとの主要ベンチマークでの比較結果、コーディング能力、日本語処理の精度について解説します。

Gemini 2.0 FlashおよびGemini 2.0 Flash Thinkingとの違い

Gemini 2.5 Proは、同じGoogle DeepMindが提供する他のGeminiモデルとは明確な差別化がなされています。主な違いは以下の通りです。

| 機能/特徴 | Gemini 2.0 Flash | Gemini 2.0 Flash Thinking | Gemini 2.5 Pro |

|---|---|---|---|

| 位置づけ | 一般提供中 | 実験段階 | 実験段階 |

| 主な用途 | 日常的なタスク | 中程度の複雑さの問題 推論と速度のバランスが必要なタスク | 複雑な問題解決 高度なコーディング |

| 推論能力 | 基本 | 中程度 | 最高レベル |

| 処理速度 | 最速 | 中程度 | 複雑な処理に最適化 |

| コンテキスト窓 | 標準 | 標準 | 100万トークン<br>(将来200万トークン) |

| 特徴 | 高速処理 効率性重視 | 思考型モデル バランス重視 | 思考型モデル マルチモーダル 長文脈処理 |

| 最適な活用場面 | 簡単な質問応答 基本的な文書作成 | 中程度の分析 基本的な問題解決 | 複雑なコード生成 大量データ分析 高度な意思決定支援 |

Gemini 2.0 Flashは「日常タスクの高速処理に最適化」されたモデルで、一般提供中です。簡易な質問応答や基本的な文書作成など、迅速なレスポンスが求められる場面で効果を発揮します。

一方、Gemini 2.0 Flash Thinkingは「推論と速度のバランスを重視」した実験段階のモデルで、中程度の複雑さを持つ問題解決に適しています。このモデルは、Gemini 2.5 Proの前身として、思考型モデルの特性を備えています。

Gemini 2.5 Proは「コーディングと複雑なプロンプトに最適」なモデルとして位置づけられ、最も強力な推論能力と長いコンテキスト窓を持ち、高度な問題解決や複雑なコーディングタスクを処理できます。

これら3つのモデルは、タスクの複雑さと処理速度のトレードオフを考慮して使い分けることで、効率的なAI活用が可能になります。

下記の記事も合わせてご覧ください。

・Gemini 2.0 Flashとは?機能と利用方法を画像付きで解説

・Gemini 2.0 Flash Thinkingとは?機能や活用法を解説

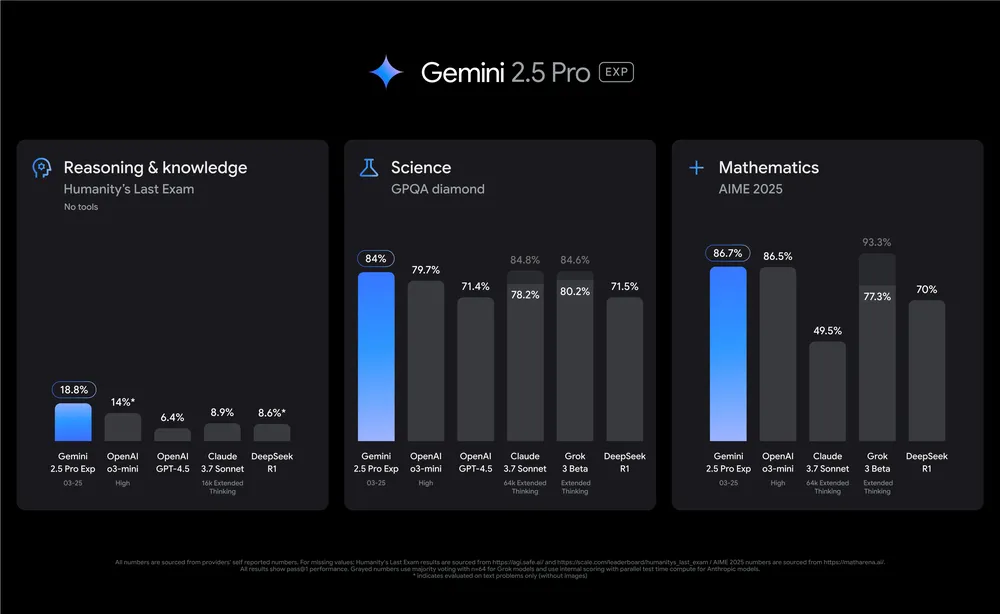

ベンチマークで見るGemini 2.5 Proの実力

Gemini 2.5 Proは、多くの主要なベンチマークテストで他の最先端モデルを上回る結果を示しています。具体的なスコアを見てみましょう。

知識のフロンティアを評価する「Humanity’s Last Exam」では18.8%を記録し、OpenAI o3-mini(14.0%)、OpenAI GPT-4.5(6.4%)、Claude 3.7 Sonnet(8.9%)、DeepSeek R1(8.6%)を大きく上回っています。

科学分野の難問を評価するGPQA diamondでは84.0%を達成し、OpenAI o3-mini(79.7%)、OpenAI GPT-4.5(71.4%)、Claude 3.7 Sonnet(78.2%)、DeepSeek R1(71.5%)よりも高いスコアを記録しました。Grok 3 Beta(80.2%)に対しても優位性を示しています。

数学の難関テストAIME 2025では86.7%という驚異的なスコアを達成し、OpenAI o3-mini(86.5%)と僅差ながらトップ、他のClaude 3.7 Sonnet(49.5%)、Grok 3 Beta(77.3%)、DeepSeek R1(70.0%)を大きく引き離しています。

また、多言語理解力を評価するGlobal MMLU (Lite)では89.8%を記録しており、この分野での比較データが公開されている他モデルを上回っています。

コーディング能力と複雑な問題解決力

Gemini 2.5 Proは、コーディング能力においても顕著な性能向上を示しています。コード生成を評価するLiveCodeBench v5では70.4%を記録し、Claude 3.7 Sonnet(70.6%)とほぼ同等、DeepSeek R1(64.3%)を上回る結果となっています(OpenAI o3-miniの74.1%には若干及びません)。

コード編集能力を測るAider Polyglotでは、whole評価で74.0%、diff評価で68.6%を達成し、OpenAI o3-mini(60.4%)、OpenAI GPT-4.5(44.9%)、Claude 3.7 Sonnet(64.9%)、DeepSeek R1(56.9%)といった他の主要モデルを上回っています。

また、エージェント型コーディング評価であるSWE-bench Verifiedでは63.8%を記録し、OpenAI o3-mini(49.3%)、OpenAI GPT-4.5(38.0%)、DeepSeek R1(49.2%)を上回りました(Claude 3.7 Sonnetの70.3%には僅かに及びません)。

Gemini 2.5 Proは、単純なコード生成だけでなく、ビジュアル的に魅力的なウェブアプリケーションの作成、既存コードの変換・編集、そしてエージェント型コードアプリケーションの開発など、様々なコーディング関連タスクで高い性能を発揮します。この能力により、開発者の生産性向上や複雑な問題解決の効率化が期待できます。

日本語処理の精度と使いやすさ

Gemini 2.5 Proは、英語だけでなく日本語を含む多言語処理においても高い精度を誇ります。多言語理解力を評価するGlobal MMLU (Lite)で89.8%という高スコアを記録していることからも、その優れた日本語処理能力が伺えます。

日本語の微妙なニュアンスや文脈の理解、自然な文章生成において、Gemini 2.5 Proは日本語ネイティブユーザーの期待に応える品質を提供します。特に、ビジネス文書や技術文書の生成・要約、複雑な日本語の質問への回答など、実務的な日本語処理タスクで高いパフォーマンスを発揮します。

さらに、Google AI StudioやGemini Advancedでは日本語インターフェースが完全にサポートされており、日本のユーザーにとって直感的に使いやすい環境が整っています。これにより、プログラミングの知識がなくても、日本語での指示だけでGemini 2.5 Proの高度な機能を活用することが可能です。

これらの比較から、Gemini 2.5 Proは特に複雑な推論を要する問題解決やコーディングタスク、そして多言語対応において、現在利用可能な最も優れたAIモデルの一つであることが分かります。

Gemini 2.5 Proを始める|利用方法と料金体系

Gemini 2.5 Proを業務で活用するには、いくつかの利用方法があります。ここでは、各プラットフォームでの利用開始方法と料金体系について解説します。

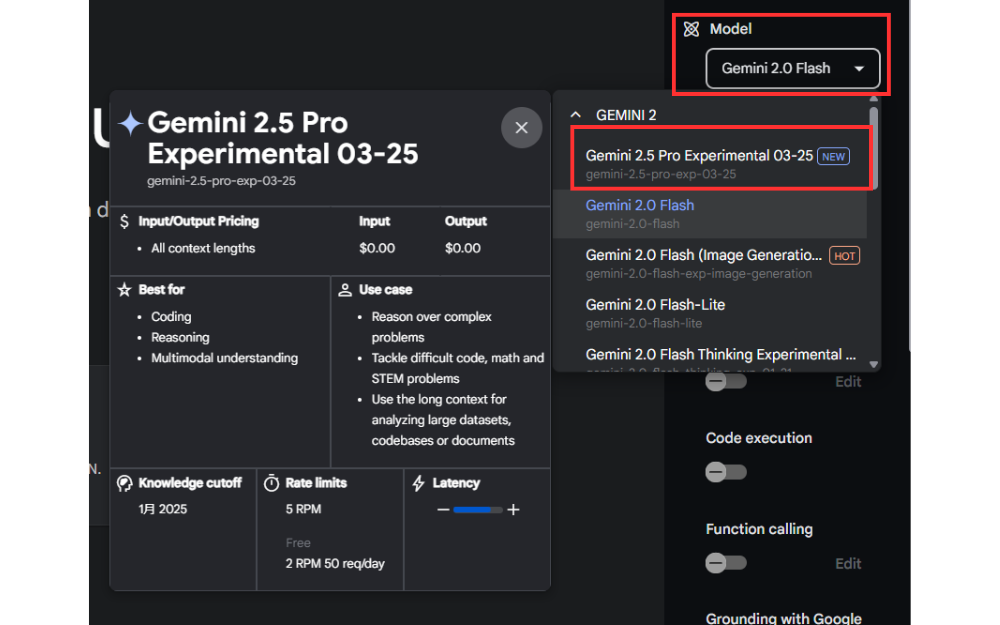

Google AI StudioとGemini Advancedでの利用開始手順

Google AI Studioは、開発者がGemini 2.5 Proを含む最新のAIモデルにアクセスするための最も簡単な方法です。利用を開始するには、以下の手順に従います。

まず、Googleアカウントを使用してGoogle AI Studioにサインインします。サインイン後、ダッシュボードのModelからGemini 2.5 Pro Experimentalを選択することができます。

Google AI Studioについては『Google AI Studioとは?始め方や何ができるかを解説【画像付き】』の記事も合わせてご覧ください。

一方、Gemini Advancedは、プログラミング知識がなくてもGemini 2.5 Proの能力を活用したい一般ユーザー向けのサービスです。Gemini Appをインストールし、設定からGemini Advancedにアップグレード(有料サブスクリプション)することで、モデル選択ドロップダウンからGemini 2.5 Pro Experimentalを選択できるようになります。デスクトップとモバイル両方から利用可能で、日常的なタスクから複雑な問題解決まで幅広く活用できます。

Vertex AIでの企業向け利用について

企業規模でGemini 2.5 Proを活用したい場合は、Google CloudのVertex AIが最適な選択肢です。Vertex AIはエンタープライズグレードのAIプラットフォームで、セキュリティ、スケーラビリティ、ガバナンスなど、企業が重視する機能を備えています。

Gemini 2.5 Proは近日中にVertex AIでも提供が開始される予定です。利用を開始するには、Google Cloudアカウントが必要となります。Vertex AI上でのGemini 2.5 Proは、APIを通じて既存のシステムに統合したり、カスタムアプリケーションを構築したりすることが可能です。

Vertex AIの企業向けメリットとしては、SLA(サービスレベル契約)保証、専門的なサポート、厳格なセキュリティとコンプライアンス対応が挙げられます。また、大規模なデータ処理や複雑なAIワークフローを構築するための豊富なツールも提供されています。

無料版と有料版の機能差と料金設定

Gemini 2.5 Proの利用には、無料オプションと有料オプションがあります。Google AI Studioでは、一定のクォータ内であれば無料で試用することができます。しかし、利用量には制限があり、高度な機能の一部にはアクセスできません。本格的な開発や大規模な利用には、有料プランへのアップグレードが必要となります。

Gemini Advancedは月額約2,000円のサブスクリプションサービスで、Google One AI Premiumプランの一部として提供されています。このプランには、Gemini Advancedの利用権に加えて、2TBのクラウドストレージやその他のGoogle Oneの特典も含まれています。

有料版と無料版の主な機能差としては、高度なモデルへのアクセス(Gemini 2.5 Proなど)、利用量上限の緩和、追加機能(長いコンテキスト窓、複雑なタスク処理など)へのアクセスが挙げられます。

API利用の価格設定と開発者向け情報

Gemini 2.5 Pro APIの詳細な価格設定は、今後数週間以内に発表される予定です。一般的には、処理されるトークン数に基づく従量課金制が採用され、企業規模や利用量に応じたさまざまなプランが用意されると予想されます。

Gemini 2.5 Proで業務効率化|活用シーン4選

Gemini 2.5 Proの高度な能力を実際のビジネスでどう活かせるか、4つの代表的な活用シーンを紹介します。

Webアプリ開発の効率化

Gemini 2.5 Proは単一のプロンプトから実行可能なコードを生成し、Webアプリ開発を効率化します。「顧客データを可視化するダッシュボードを作成して」という指示だけで、データ処理から視覚化までの完全なコードを生成。UIデザインの自動提案やインタラクティブ要素の実装も支援し、開発時間を大幅に短縮します。

高度なコード生成とデバッグの自動化

コーディング関連タスクでも優れた能力を発揮し、既存コードのリファクタリング、バグの特定と修正提案、新機能の実装コード生成が可能です。Aider Polyglotで74.0%、SWE-bench Verifiedで63.8%という高スコアは、実用レベルのコード生成・編集能力を証明しています。

複雑な問題解決と意思決定支援

高度な推論能力により、複数の選択肢の比較分析、リスク評価と対策立案、複雑なプロジェクト計画の最適化をサポートします。大量の市場データや競合情報を分析して戦略的提言を生成することで、データに基づいた意思決定の質とスピードを向上させます。

大量データからのインサイト抽出と分析

100万トークン対応の長文脈処理能力により、複数の長文レポートからの包括的要約や、大量の顧客フィードバックからのトレンド抽出が可能です。時系列データの傾向分析や予測も高精度で行い、データ分析の時間短縮と洞察の発見をサポートします。

Gemini 2.5 Proの効果を最大化するコツ

Gemini 2.5 Proの高度な機能を最大限に活用するには、モデルの特性を理解した適切な活用方法が重要です。ここでは実務で即活用できる主要なテクニックを紹介します。

思考型モデルを活かす最適なプロンプト設計

Gemini 2.5 Proのような思考型モデルに対するプロンプト設計は従来のAIと異なるアプローチが効果的です。

最も重要なのは、目的を明確にして指示をシンプルに伝えることです。余計な飾りを省き、直接的に質問や指示を出すことで、AIの推論能力を最大限に活かせます。複雑な説明や長すぎるプロンプトはかえって回答の質を下げる可能性があります。

また、出力形式を具体的に指定すると良いでしょう。「表形式で」「3つの要点にまとめて」など、求める回答の形式を明示することで、より実用的な結果が得られます。

従来の「ステップバイステップで考えて」や「あなたは〇〇の専門家です」といったテクニックは、Gemini 2.5 Proでは必ずしも必要ではなく、シンプルな指示の方が適切な回答を引き出せる場合が多いです。

マルチモーダル機能の実践的な活用法

複数形式の情報を同時に提供することで、より豊かな理解を促進できます。製品マニュアルのスクリーンショットとテキスト説明を同時に入力したり、「この設計図から技術的な課題を特定してください」と具体的な観点を指定したりすることが効果的です。

画像とコードの連携も強力で、「このモックアップ画像をHTMLとCSSで実装してください」といった指示で、ビジュアルデザインから実装コードを直接生成できます。

ユースケース別の設定最適化テクニック

ユースケースに合わせた設定最適化も重要です。創造的タスクではTemperatureを高め(0.7〜0.9)に、事実確認や技術ドキュメント作成では低め(0.1〜0.3)に設定しましょう。コード生成では用途に応じて中程度(0.4〜0.6)から調整します。

Gemini 2.5 Pro活用の主要テクニックまとめ

・思考過程の明示的な要求:ステップバイステップの指示

・複数形式情報の同時活用:画像と説明文の組み合わせ

・ユースケースに応じた温度設定:創造性と正確性のバランス調整

・出力形式の明示的な指定:マークダウン、表、JSON形式など

まとめ:Gemini 2.5 Proで実現するビジネスの未来

Gemini 2.5 Proは思考型モデルとしての高度な推論能力、ネイティブマルチモーダル対応、100万トークンの長文脈処理能力を備えた次世代AIです。ベンチマークでトップレベルの性能を示し、Webアプリ開発、コード生成、複雑な問題解決、データ分析など様々な業務プロセスの革新を可能にします。Google AI StudioやGemini Advancedですぐに利用を開始でき、まずは小規模な実験から始めることをお勧めします。プロンプト設計の工夫と設定最適化により効果をさらに高められるでしょう。この強力なツールを賢く活用することで、より創造的で効率的なビジネスプロセスを実現し、競争力を高めていくことができます。

【生成AI活用でお困りではないですか?】

株式会社アドカルは主に生成AIを活用したマーケティングDXや業務効率化に強みを持った企業です。

貴社のパートナーとして、少数精鋭で担当させていただくので、

「生成AIを業務に活用したい」

「業務効率を改善したい」

「自社の業務に生成AIを取り入れたい」

とお悩みの方は、ぜひ弊社にご相談ください。

貴社のご相談内容に合わせて、最適なご提案をさせていただきます。

サービスの詳細は下記からご確認ください。無料相談も可能です。